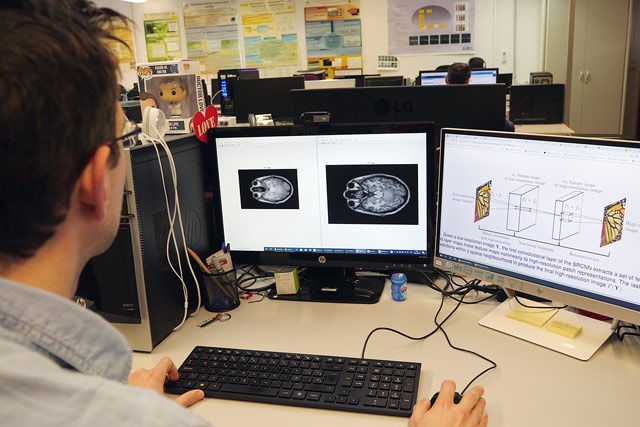

Utilizan la inteligencia artificial para mejorar la resolución de imágenes de resonancia magnética del cerebro

El método diseñado por investigadores de la Universidad de Málaga permite detectar patologías con mayor precisión y nitidez, sin necesidad de pruebas complementarias. Se trata de un nuevo modelo que ha permitido que las imágenes pasen de baja resolución a alta, sin distorsionar las estructuras cerebrales de los pacientes, utilizando una red neuronal artificial profunda –modelo inspirado en el funcionamiento del cerebro humano- que ‘aprende’ este proceso.

Fuente: Universidad de Málaga

Investigadores del Grupo ICAI -Inteligencia Computacional y Análisis de Imágenes- de la Universidad de Málaga han diseñado un método inédito capaz de mejorar las imágenes del cerebro obtenidas por resonancia magnética usando la inteligencia artificial.

Este método permite detectar patologías con mayor precisión y nitidez, sin necesidad de pruebas complementarias.

Se trata de un nuevo modelo que ha permitido que las imágenes pasen de baja resolución a alta, sin distorsionar las estructuras cerebrales de los pacientes, utilizando una red neuronal artificial profunda –modelo inspirado en el funcionamiento del cerebro humano- que ‘aprende’ este proceso.

“El aprendizaje profundo está basado en redes neuronales muy extensas, con lo que su capacidad para aprender lo es también, alcanzando la complejidad y abstracción de un cerebro”, explica el investigador Karl Thurnhofer, autor principal de este estudio, que señala que gracias a esta técnica se pueden realizar tareas de identificación por sí mismas, sin supervisión, de las que ni el ojo humano sería capaz.

Este avance investigador ha sido publicado por la revista científica ‘Neurocomputing’, que recoge como el algoritmo desarrollado en la UMA obtiene resultados de mayor precisión en menos tiempo, con claros beneficios para los pacientes. “Hasta ahora la adquisición de imágenes cerebrales de calidad dependían del tiempo que el paciente estuviera inmovilizado en el escáner, con nuestro método el procesamiento de la imagen se hace posteriormente en el ordenador”, aclara Thurnhofer.

Según los expertos, los resultados permitirán a los especialistas identificar de forma más nítida y precisa patologías relacionadas con el cerebro como lesiones físicas, cánceres o trastornos del lenguaje, entre otras, ya que los detalles de las imágenes son más finos, evitando así tener que recurrir a pruebas complementarias ante diagnósticos dudosos.

El Grupo ICAI de la UMA, que dirige el catedrático Ezequiel López, también autor de este trabajo, es hoy referente en neurocomputación, aprendizaje computacional e inteligencia artificial. Los profesores del Departamento de Lenguajes y Ciencias de la Computación Enrique Domínguez y Rafael Luque, así como la investigadora Núria Roé-Vellvé, también han participado en el estudio.

Últimas publicaciones

Gómez Villamandos fue presidente de la Fundación Descubre desde diciembre de 2022. Durante su etapa al frente de la Consejería impulsó una profunda transformación del sistema universitario y científico andaluz, dejando sentadas las bases del futuro. Entre sus principales hitos destacan la aprobación de la nueva Ley Universitaria para Andalucía.

Sigue leyendoUn estudio de la Universidad de Córdoba revela las motivaciones del sector agrícola andaluz para adoptar prácticas ecológicas en una tierra que concentra el 50% de este tipo de cultivos a nivel nacional.

Una docena de talleres y observaciones se llevarán a cabo en localidades de las provincias de Cádiz, Sevilla, Huelva, Málaga, Jaén y Granada. El plazo de inscripción en esta iniciativa continúa abierto.

Sigue leyendo